在多变量时间序列回归问题中,我们的目标是使用先前的多个变量观测来预测未来的值。GRU(Gated Recurrent Unit)是一种循环神经网络(RNN)的变体,用于处理时间序列数据。下面是关于如何使用GRU进行多变量时间序列回归预测超前24个时间步的方法和原理介绍:

GRU简介

GRU是一种循环神经网络结构,旨在解决标准RNN的梯度消失问题和长期依赖问题。它具有内部门控制机制,通过这些门控机制可以更好地捕捉序列中的关键信息。

GRU的核心部分包括:

更新门(Update Gate):决定是否更新内部状态。

重置门(Reset Gate):控制前一个状态的遗忘程度。

当前状态(Current State):根据更新门和重置门的决策来计算当前状态。

输出:当前状态经过一些变换后作为输出。

多变量时间序列回归问题

多变量时间序列回归问题通常涉及以下步骤:

数据准备:多个变量观测数据的采集,包括历史时间点上的值。这些变量可以代表不同的特征或属性,例如气象数据中的温度、湿度、风速等。

数据处理:数据被处理成合适的格式,例如将其转换为4D数组以供神经网络处理。数据通常分为训练集和测试集。

网络架构:构建适合多变量时间序列回归的神经网络结构。在这种情况下,GRU是一个很好的选择,因为它可以处理序列数据。

参数设置:定义训练神经网络的参数,包括学习率、迭代次数、批处理大小等。

训练网络:使用训练数据对神经网络进行训练,通过反向传播算法来调整网络权重。

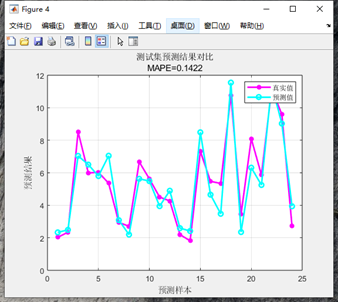

预测:使用训练好的模型对未来的值进行预测。在这里,您希望预测未来的24个时间步。

超前24步的预测

为了预测未来24个时间步,可以进行以下操作:

使用前面的时间步(历史数据)作为输入,使用GRU模型进行前向传播。

GRU模型将内部状态(current state)更新为当前时间步的信息,并在每个时间步输出预测。

将输出作为下一个时间步的输入,并将其反复应用到未来24个时间步。

这将生成未来24个时间步的预测值,其中每个时间步都取决于前一个时间步的预测。

计算预测值与实际观测值之间的误差,然后使用误差来调整模型的权重以提高预测性能。

最终,可以获得超前24个时间步的预测结果。

GRU具有内部门控制机制,可以学习时间序列中的复杂依赖关系,因此在多变量时间序列回归问题中通常能够提供较好的性能。在训练模型时,适当的数据预处理和参数调整也是关键因素。

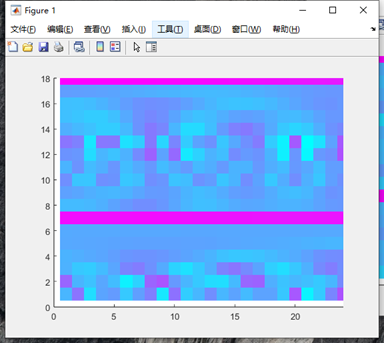

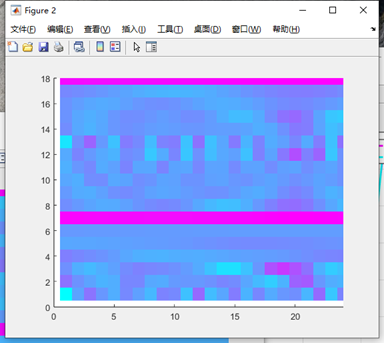

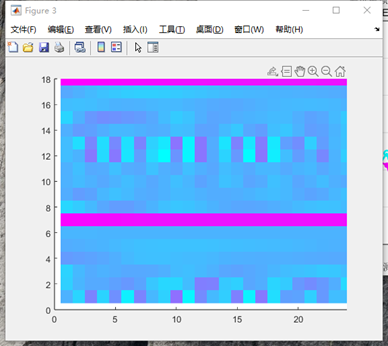

程序结果: