代码功能

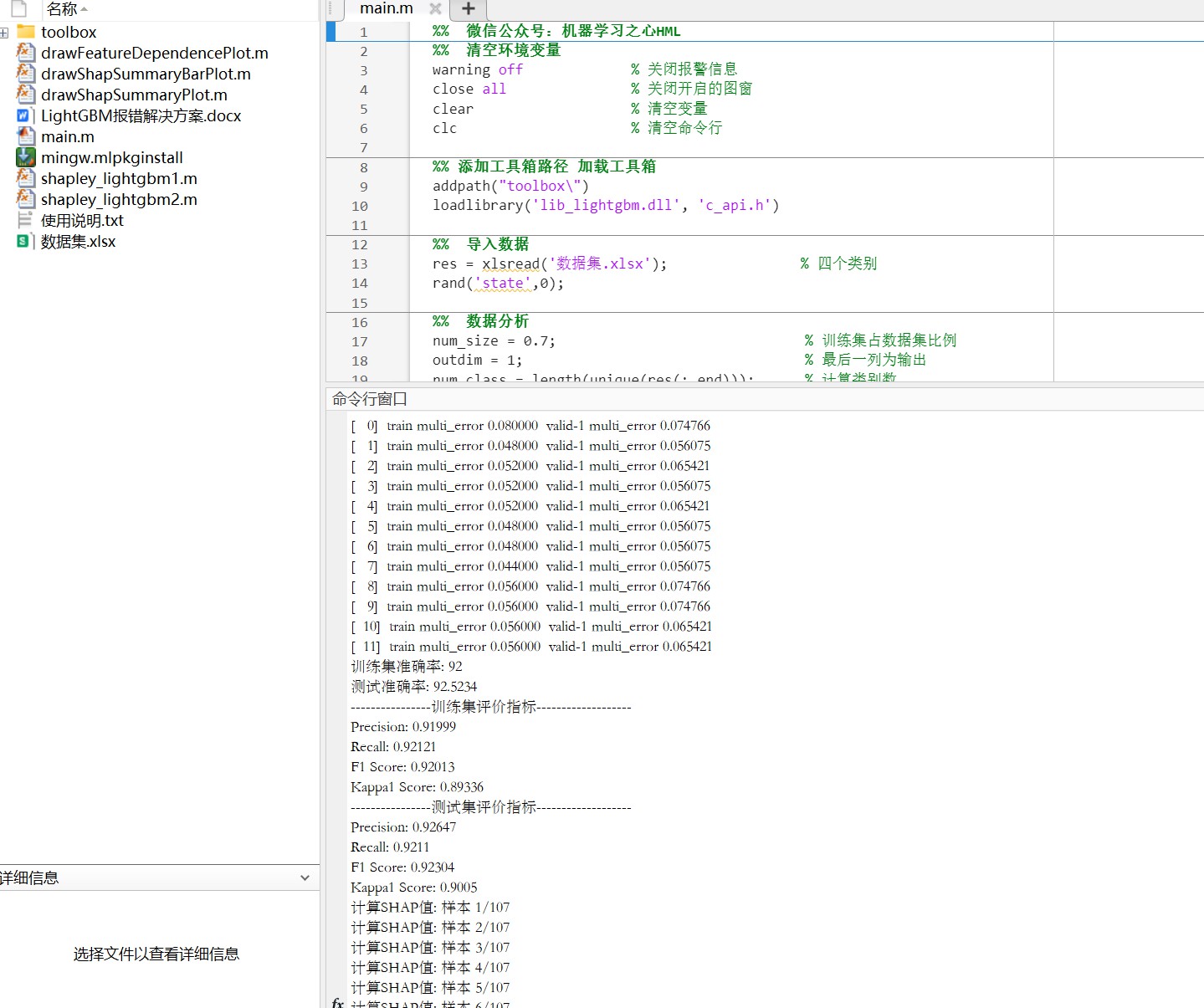

LightGBM分类预测+特征贡献SHAP分析+特征依赖图!机器学习可解释分析,Matlab代码实现,该MATLAB代码实现了一个基于LightGBM的分类模型,并集成了SHAP可解释性分析框架。主要功能包括:

1. 数据预处理:数据打乱、分层划分训练/测试集、归一化处理

2. 神经网络建模:构建LightGBM分类模型

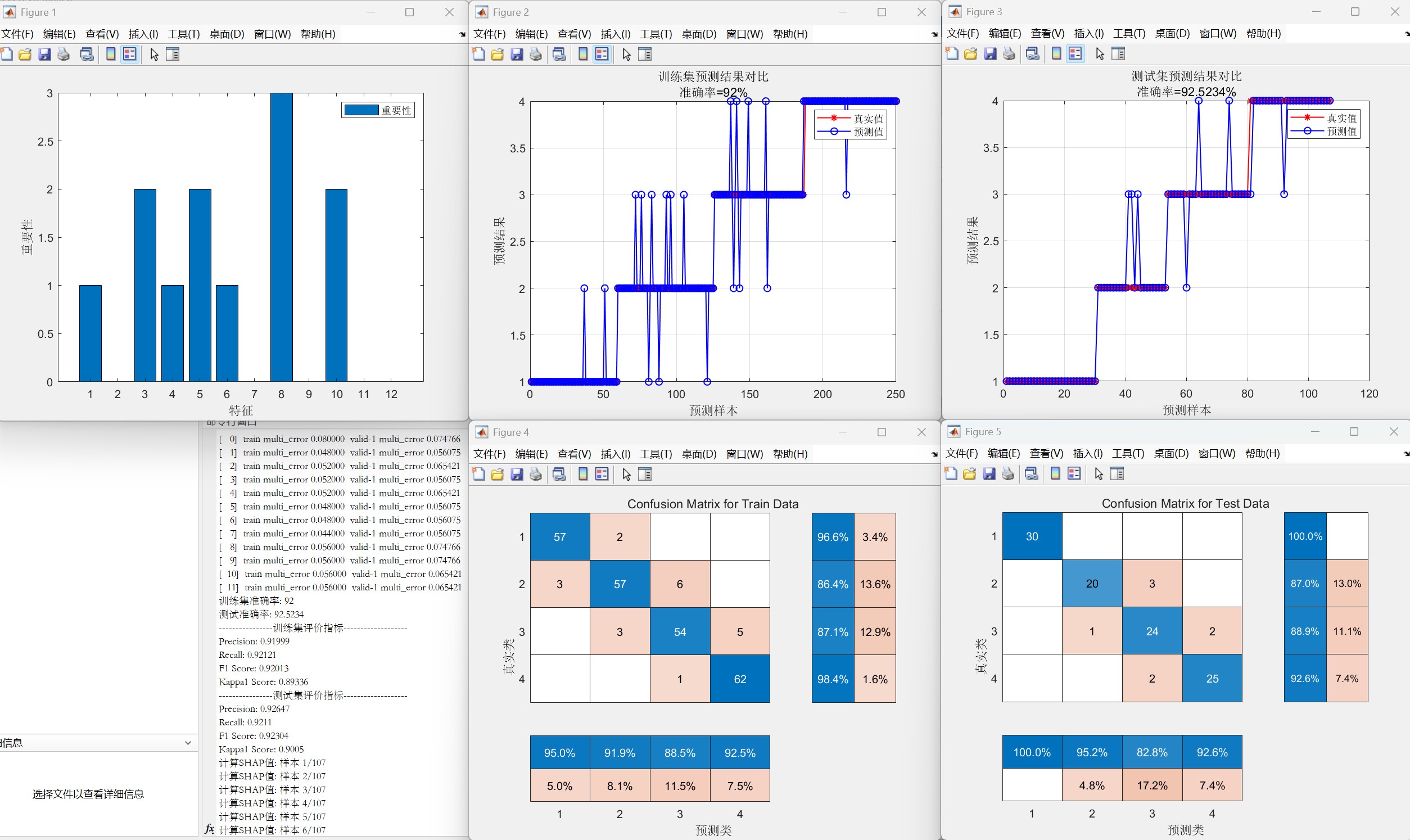

3. 模型评估:计算分类准确率、绘制预测结果对比图、生成混淆矩阵

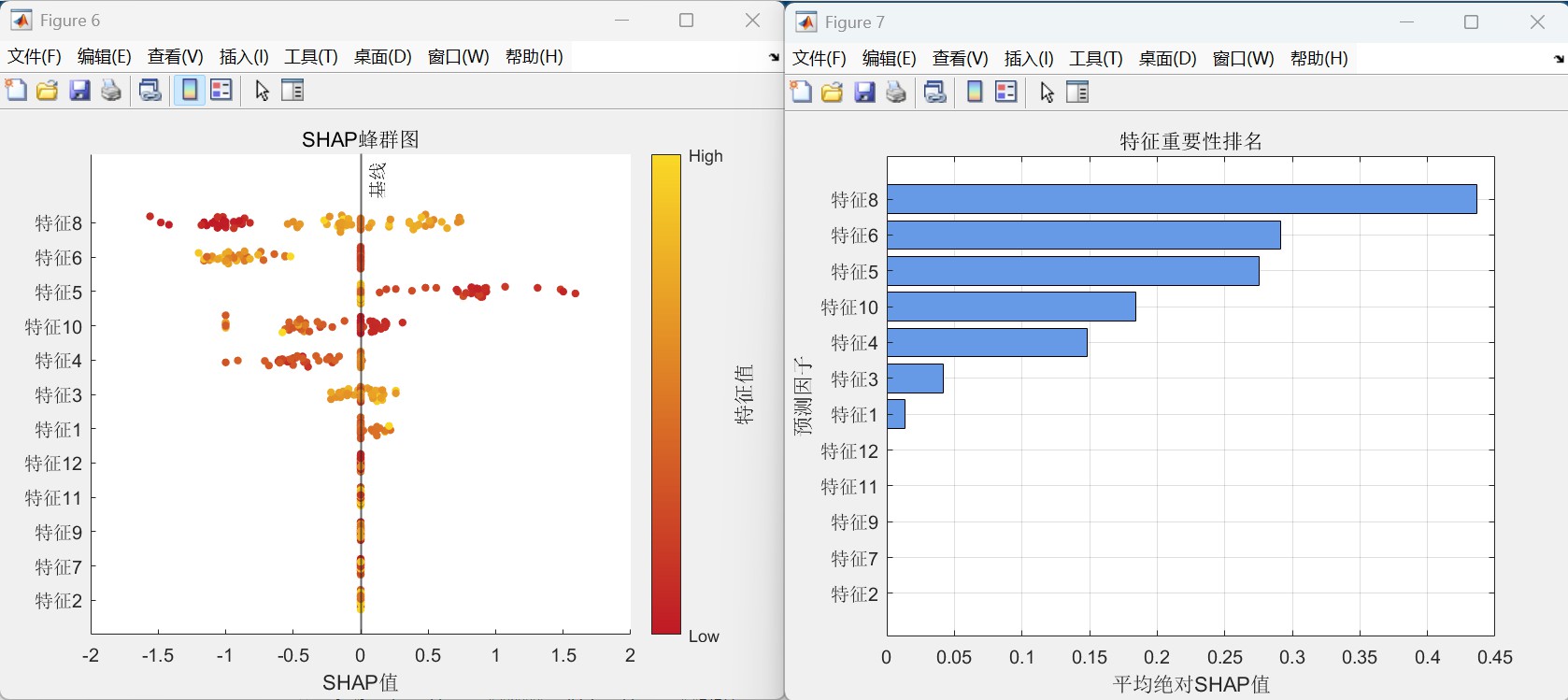

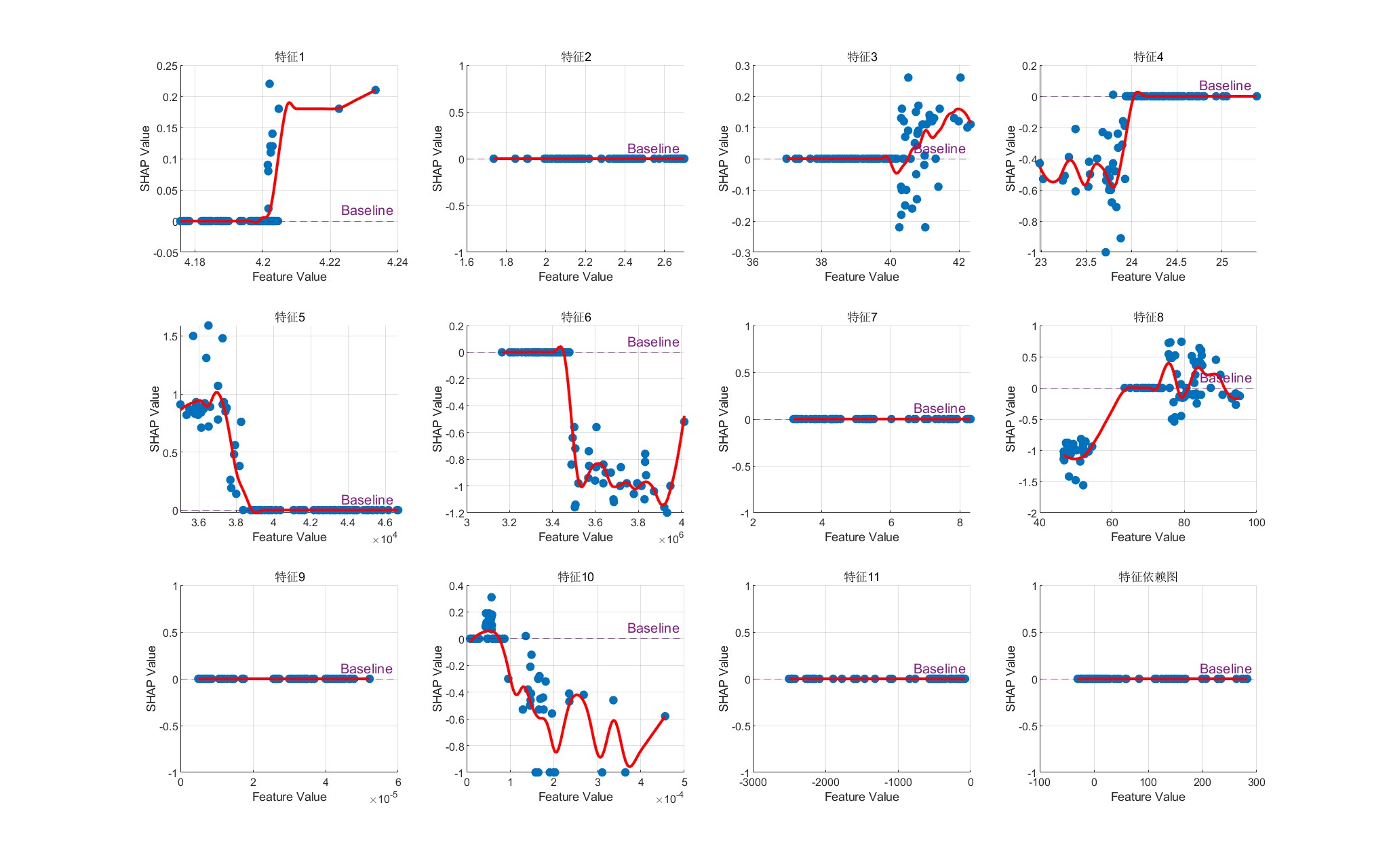

4. 可解释性分析:计算SHAP值、绘制特征重要性图、依赖关系图等可解释性图表

算法步骤

1. 数据准备阶段

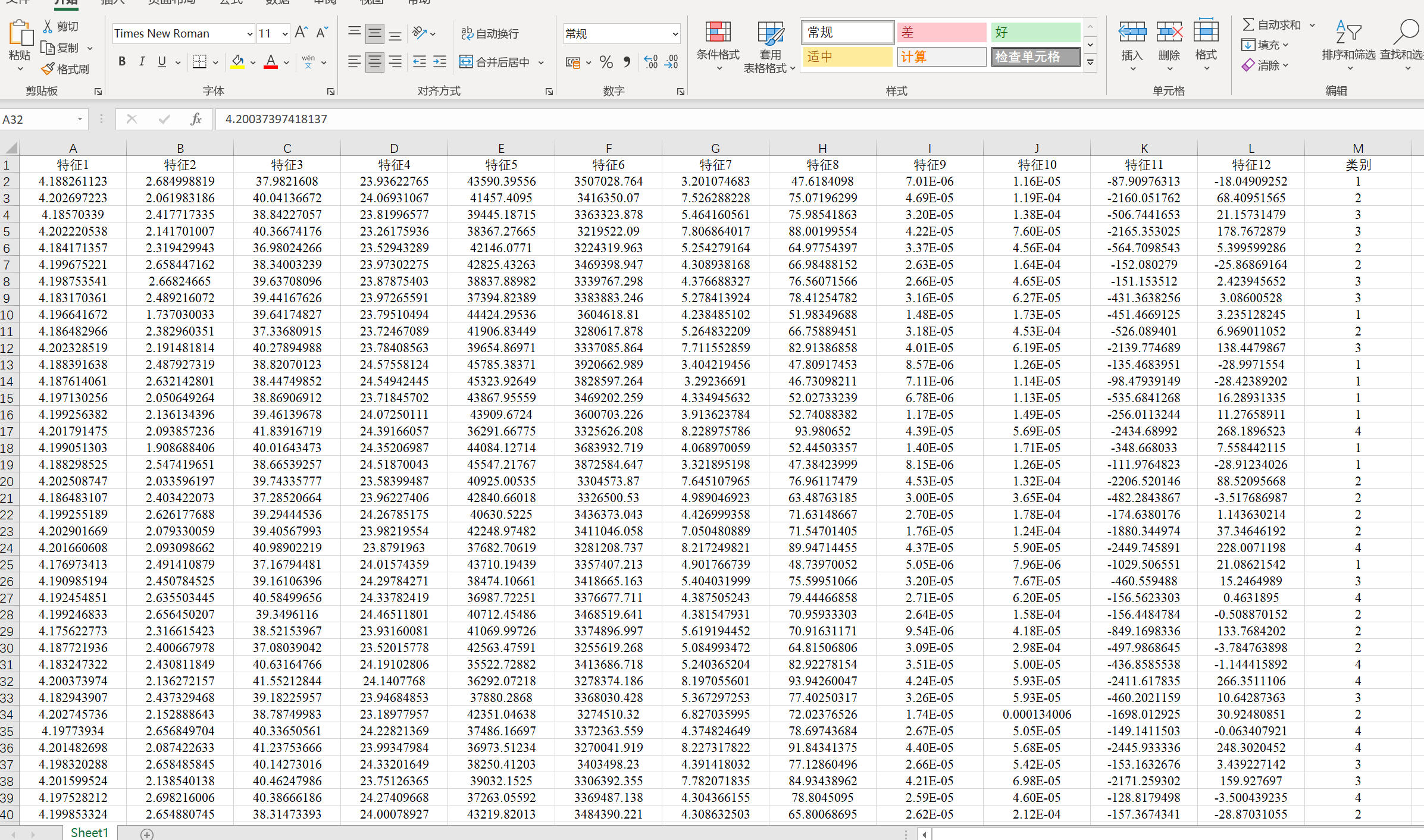

• 导入Excel数据集(最后一列为类别标签)

• 分析数据维度(特征数/类别数/样本数)

• 随机打乱数据集

• 按类别分层抽样(70%训练集,30%测试集)

2. LightGBM建模

• 数据归一化(mapminmax)

• 创建网络:LightGBM

3. 模型验证

• 计算分类准确率

• 绘制预测结果对比

• 生成混淆矩阵(confusionchart)

4. SHAP可解释性分析

• 选择测试样本(默认全量)

• 计算参考值(训练集均值)

• 逐样本计算SHAP值

• 可视化分析:

• SHAP摘要图(特征贡献分布)

• 特征重要性条形图(平均|SHAP|)

• 特征依赖图(特征值-SHAP值关系)

运行环境要求

MATLAB版本:2020b或更高(依赖confusionchart)

应用场景

1. 多分类问题:支持任意类别数的分类任务

2. 模型可解释性需求:

• 医疗诊断(需解释特征贡献)

• 金融风控(需符合监管解释要求)

• 工业故障检测(需定位关键特征)

3.学术研究:机器学习可解释性方法验证

注:SHAP分析计算复杂度为O(2^M*N),特征维度(M)较高时建议减少numShapSamples值。实际应用中需根据特征含义修改featureNames数组。

数据集