提示:需要matlab 2023a版本以上

INFO-LSTM-SelfAttention是一种用于回归预测的神经网络模型,结合了长短期记忆(LSTM)神经网络、自注意力机制和向量加权平均算法。下面详细介绍这个模型在回归预测任务中的工作流程:

1. 数据预处理

- 输入数据:时序数据序列,如股票价格、气象数据等。

- 数据归一化:对输入数据进行归一化处理,以加速模型训练并提高模型的稳定性。

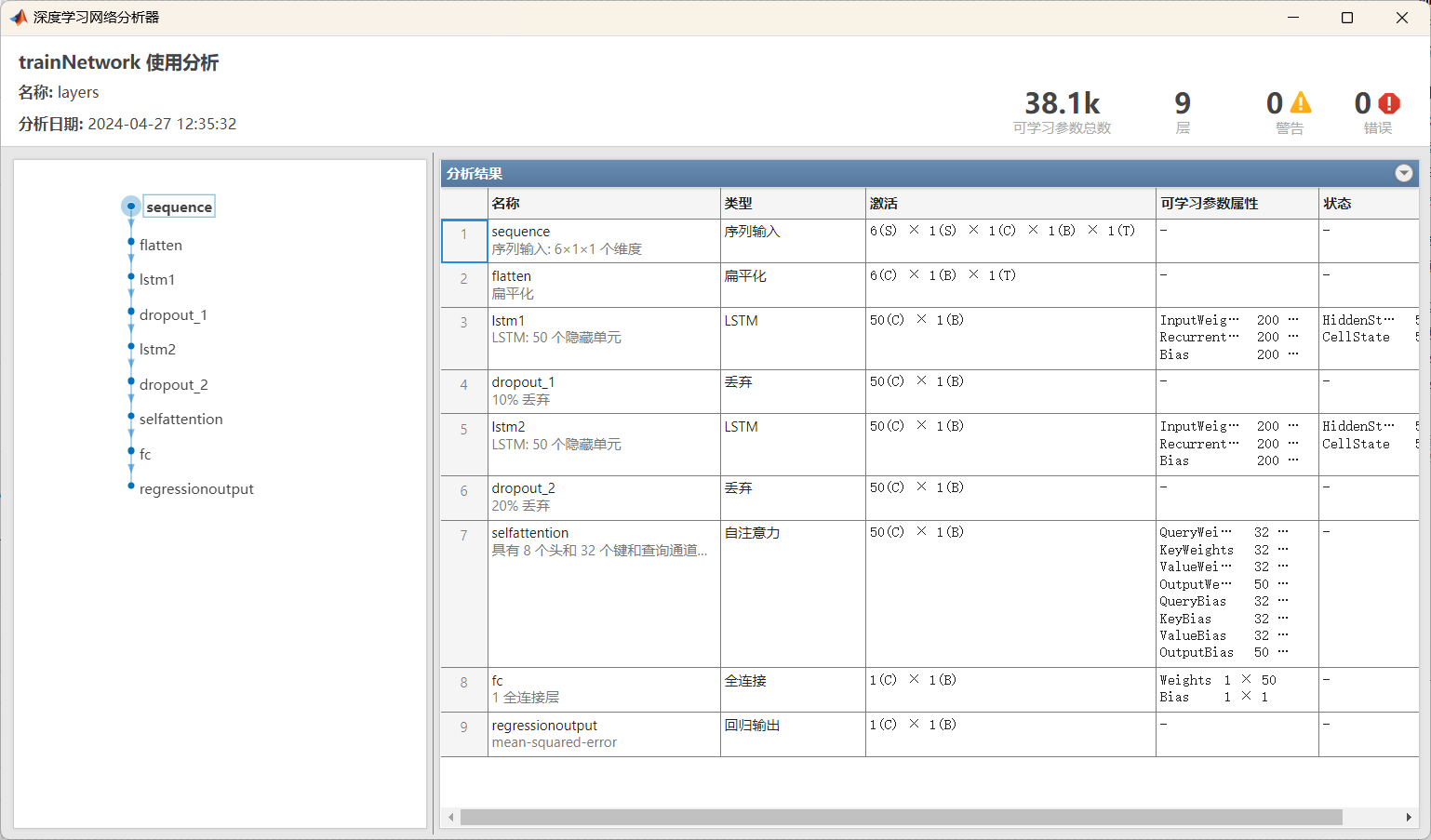

2. 构建模型结构

- LSTM层:接受输入数据序列,并学习序列中的长期依赖关系。

- 自注意力层:在LSTM层之后引入自注意力机制,以捕捉序列中不同部分的重要性。

- 向量加权平均层:根据自注意力层的输出和向量加权平均算法,动态地调整每个特征的权重。

- 全连接层:将向量加权平均层的输出传递到全连接层,进行回归预测。

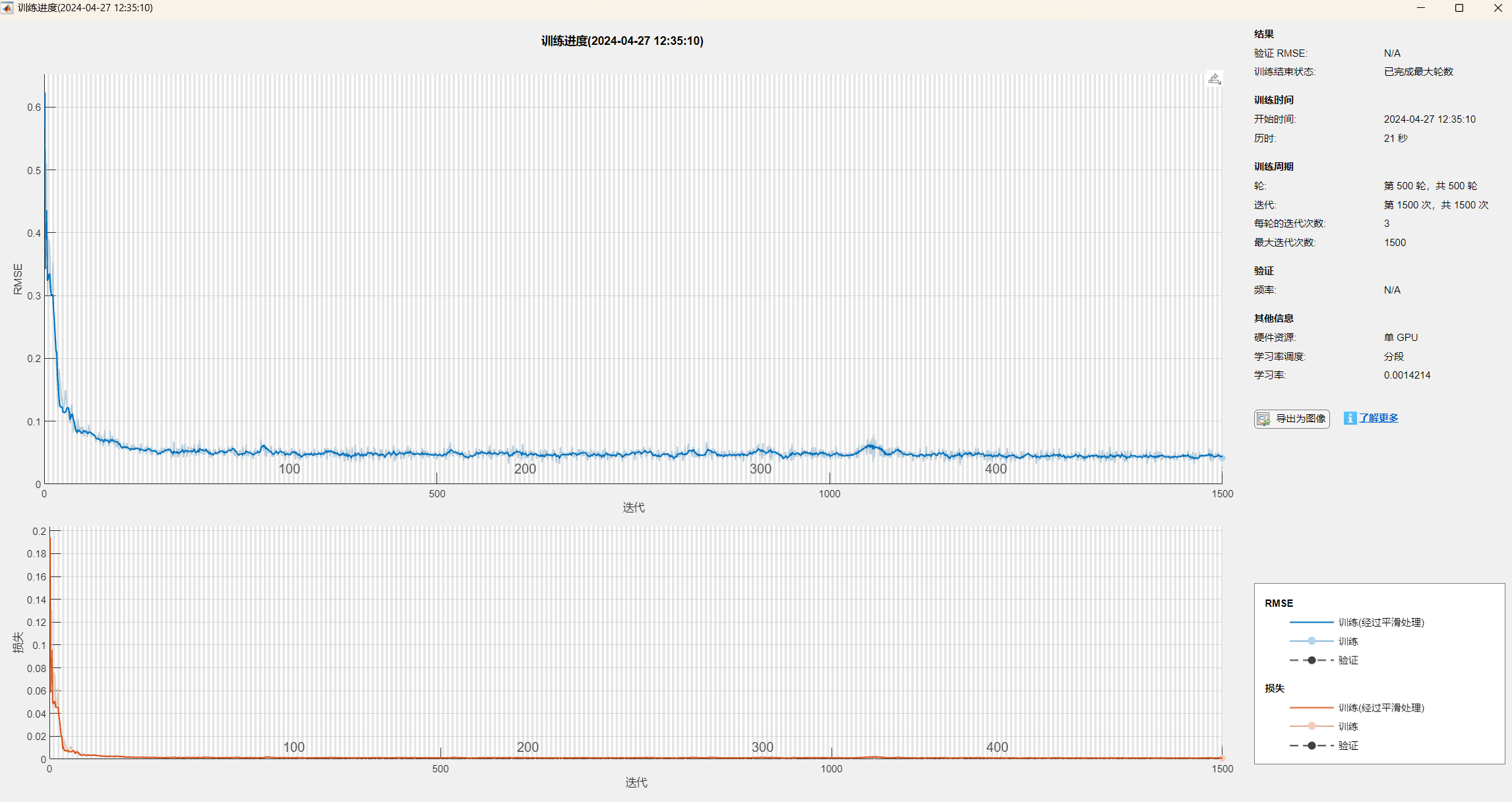

3. 训练模型

- 利用训练数据对模型进行训练,通过反向传播算法优化模型参数。

- 使用验证集监控模型的性能,并根据验证集的表现进行调整,以防止过拟合。

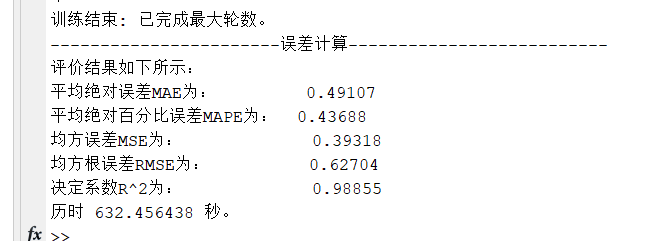

4. 模型预测

- 使用训练好的模型对测试数据进行预测,得到回归结果。

5. 向量加权平均算法优化

- 在训练过程中,利用向量加权平均算法动态地调整模型的超参数,如L2正则化参数和初始学习率,以优化模型性能。

- 根据模型在不同超参数组合下的历史表现,计算每个超参数组合的权重,并更新超参数的选择。

优势

- 有效利用时序信息:通过LSTM层,模型能够捕捉时序数据中的长期依赖关系。

- 关注重要信息:引入自注意力机制和向量加权平均算法,使模型能够动态地关注序列中的重要部分,提高了预测的准确性。

- 自适应调整超参数:利用向量加权平均算法优化超参数选择,使模型更好地适应不同数据集和问题的特点。

应用

INFO-LSTM-SelfAttention模型适用于各种回归预测任务,如股票价格预测、气象数据预测、交通流量预测等。它在处理时序数据时具有优秀的性能,并且能够灵活地适应不同的应用场景。