YOLOv5是一种目标检测算法,它是YOLO(You Only Look Once)系列模型的进化版本。YOLOv5是由Ultralytics开发的,基于一阶段目标检测的概念。其目标是在保持高准确率的同时提高目标检测的速度和效率。

与传统的目标检测算法相比,YOLOv5具有以下特点:

- 快速而准确:YOLOv5采用了一种基于神经网络的方法,能够在图像中快速而精确地检测出多个目标。它能够在实时场景中实现高帧率的目标检测。

- 单阶段检测:YOLOv5采用了一阶段检测的方法,将目标检测任务作为一个回归问题来解决。这意味着它可以直接从输入图像中预测出目标的类别和位置信息,而无需使用复杂的候选区域生成和筛选过程。

- 多尺度特征融合:为了增强目标检测的准确性,YOLOv5引入了多尺度特征融合的机制。它通过在不同层级的特征图上进行信息融合,使得网络可以同时检测不同尺度的目标。

- 轻量级和灵活性:YOLOv5的设计注重模型的轻量化和灵活性。它提供了多个不同大小的预训练模型,以满足不同场景和设备的需求。此外,YOLOv5还支持自定义数据集的训练,可以根据具体任务进行模型的调整和优化。

总的来说,YOLOv5是一种高效且准确的目标检测算法,适用于各种实时场景,如物体跟踪、行人检测、交通监控等。它在目标检测领域取得了显著的进展,并得到了广泛的应用和研究。

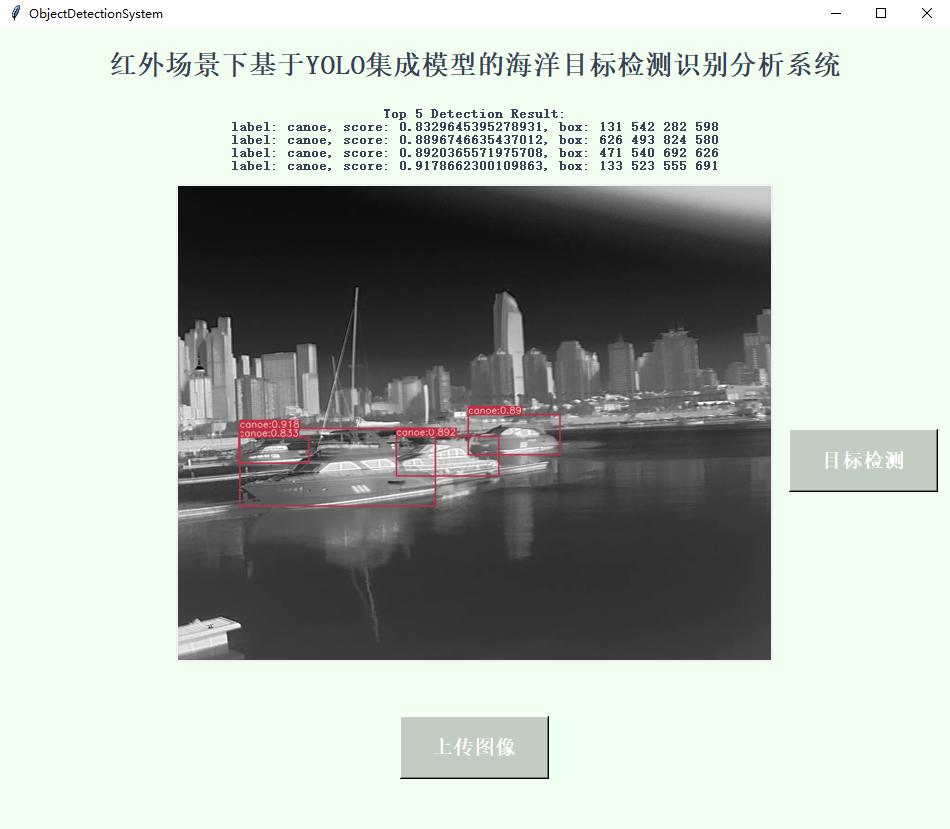

本项目主要是融合yolov5n和yolov5s两个模型来开发构建远红外场景下的海洋目标检测,系统效果如下所示:

简单看下数据集:

实例标注内容如下:

1 0.974219 0.28418 0.051562 0.021484 1 0.947656 0.302734 0.051562 0.019531 1 0.889062 0.296875 0.065625 0.027344 1 0.851562 0.302734 0.059375 0.023438 1 0.836719 0.319336 0.073438 0.033203 1 0.80625 0.319336 0.065625 0.029297 1 0.785937 0.329102 0.0625 0.029297 1 0.772656 0.339844 0.085938 0.027344 1 0.730469 0.348633 0.076563 0.029297 1 0.836719 0.359375 0.085938 0.023438 1 0.580469 0.416992 0.085938 0.037109 1 0.560937 0.429688 0.06875 0.039062 1 0.942187 0.383789 0.103125 0.126953 1 0.891406 0.396484 0.154688 0.140625 1 0.871094 0.417969 0.151562 0.136719 1 0.8625 0.442383 0.15625 0.130859 1 0.835938 0.439453 0.1875 0.148438 1 0.803906 0.453125 0.182812 0.144531 1 0.789844 0.473633 0.179688 0.146484 1 0.75625 0.487305 0.171875 0.138672 1 0.7125 0.504883 0.20625 0.142578 1 0.682813 0.513672 0.16875 0.15625 1 0.657031 0.521484 0.214062 0.140625 1 0.614844 0.550781 0.214062 0.179688 1 0.548438 0.561523 0.203125 0.189453 1 0.46875 0.589844 0.23125 0.160156 1 0.402344 0.614258 0.210938 0.216797 1 0.355469 0.696289 0.132812 0.083984 1 0.496875 0.569336 0.165625 0.193359

这里的主要方式是基于Ensemble集成模型技术来实现最终的预测,所以需要开发的模型至少要有两种,这里我选择的n和s系列的模型,当然你可以可以选择其他的或者更多的中都是可以的,最终推理的时候把模型清单加入推理列表即可。如下:

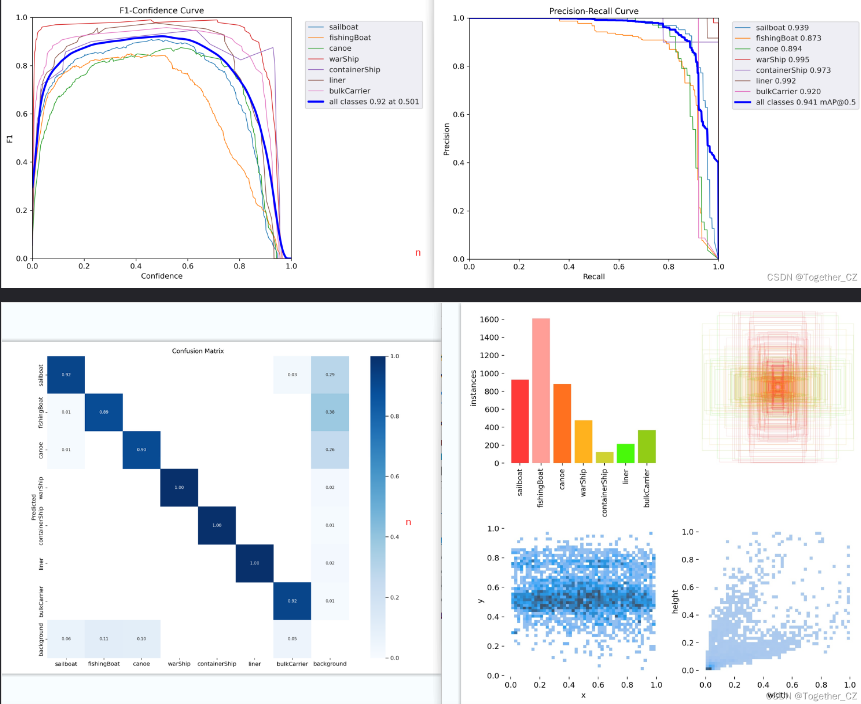

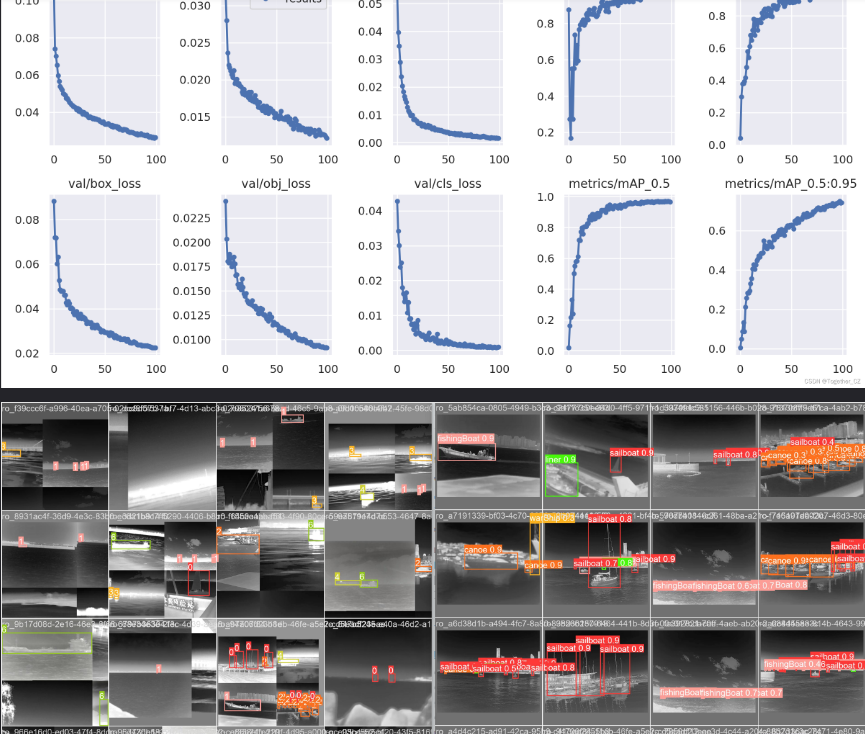

训练结果实例如下:

整体项目详情如下所示:

dataset是数据集目录:

测试集50张

训练集500张

可以自行替换或者增加都是可以的。

使用操作:

双击【启动训练.bat】即可启动模型训练,模型已训练好了不用再次训练

双击【启动系统.bat】即可启动可视化系统,系统不可编辑修改,实例效果如下所示:

故而给到很低的价格,可以根据自己的实际需要拍即可。

有任何问题可以直接添加微信 CBelovedAZX 联系咨询即可。