原文链接:https://blog.csdn.net/weixin_50174671/article/details/148498651

一、yolov11+双目测距基本流程

yolov11 + 双目测距的大致流程就是:

双目标定 --> 立体校正(含消除畸变) --> 立体匹配 --> 视差计算 --> 深度计算(3D坐标)计算 --> 目标检测 --> 目标距离计算及可视化

下面将分别阐述每一个步骤并使用python来实现。

二、双目测距

其中双目测距的原理及过程请查看我下面的博客

三、目标检测

在本项目中,我们选用了轻量级且高效的目标检测模型 YOLOv11,并使用其 ONNX格式模型部署,结合OpenCV和ONNX Runtime完成前向推理,实现高性能目标识别。整个检测流程主要包括 模型转换、图像预处理、模型推理、后处理 四个步骤。

四、目标距离计算及可视化

在完成目标检测的后处理阶段后,系统已经获得每个候选目标的二维图像坐标和置信度信息。为了进一步实现三维感知功能,本系统结合双目测距模块输出的 points_3d,实现目标距离的估算与图像可视化展示。

五、整体代码介绍

本代码实现了基于双目立体视觉的目标检测与测距系统,涵盖了畸变矫正、立体校正、视差计算及深度计算和目标检测关键步骤。

测距模块从 stereoconfig 模块中加载相机标定参数,包括内外参和畸变系数,利用 OpenCV 的 cv2.stereoRectify() 对左右相机图像进行立体校正,保证图像对齐。随后,采用 SGBM(半全局匹配算法)计算视差图,并结合 WLS(加权最小二乘滤波)滤波器对视差图进行优化,提高视差的平滑性和准确性。接着,通过 cv2.reprojectImageTo3D() 将视差图转换成三维点云,得到每个像素的三维信息。检测模块基于ONNX格式的YOLO模型,结合后处理与非极大值抑制筛选检测框,并计算目标中心点的三维坐标实现距离估计。

系统支持两种运行模式:图片模式(imagemode)用于处理静态双目图像,摄像头模式(cameramode)支持实时视频流处理,实现动态测距与目标检测。可根据自己需求进行相应选择。

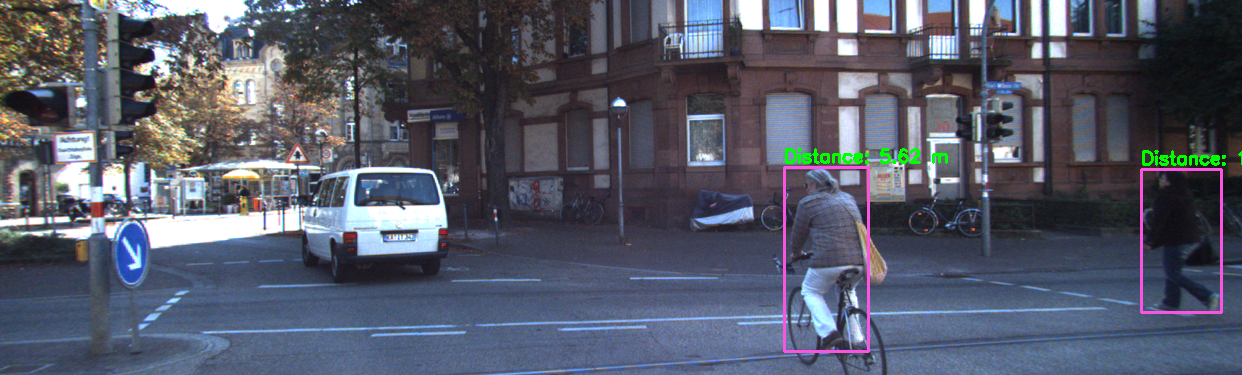

效果如下所示: